Por Rodrigo Duarte

Presuntos audios de políticos del partido oficialista Morena han causado controversia en México, con los protagonistas aclarando que eran supuestos montajes. Sputnik habló con especialistas en la intersección entre tecnología y política para analizar cuál será el impacto de la inteligencia artificial (IA) en los próximos comicios presidenciales.

El pasado 31 de octubre, comenzó a viralizarse un supuesto audio del jefe de Gobierno de la Ciudad de México, Martí Batres, en el cual daba ordenes para perjudicar a Omar García Harfuch, quien buscaba la candidatura del oficialismo para gobernar la capital mexicana. En el audio, Batres pedía apuntalar la candidatura de Clara Brugada en detrimento de García Harfuch.

A las pocas horas, cuando el audio ya había sido difundido por prácticamente todos los medios de comunicación del país, Batres desmintió que se tratara de un mensaje suyo y explicó que era una falsificación realizada con inteligencia artificial.

Apenas unos días antes, la reñida pelea electoral para ser el candidato del oficialismo en la Ciudad de México ya se había visto impactada por otra controversia relacionada a explosivas declaraciones, esta vez adjudicadas a la ahora candidata Clara Brugada, que también fueron tildadas de apócrifas.

En un video posteado inicialmente en redes sociales, se escuchaba decir a la aspirante, en su acto de inscripción de registro de precandidata del pasado mes de septiembre, que «para mantener los apoyos sociales en la Ciudad de México va a duplicar los impuestos», ya que era «el momento de repartir la riqueza» de la capital.

Inmediatamente, Brugada salió al cruce del video asegurando que el audio que acompañaba las imágenes había sido «elaborado con IA» y que «ninguna parte de su contenido corresponde a conversaciones reales

Pero la estrategia de uso de la IA no ha sido solamente utilizada en las últimas semanas para generar desinformación sobre los políticos mexicanos. Ricardo Monreal, en aquel momento precandidato de Morena para la Presidencia de México, subió en agosto un video en el que se lo ve conversando con Benjamin Franklin, uno de «los padres fundadores de Estados Unidos» que lleva casi 250 años muerto, para reclamar a Washington «un trato más humanitario» de los migrantes mexicanos, mientras que la campaña de la candidata presidencial opositora Xóchitl Gálvez presentó una serie de spots en que una versión más joven de la exsenadora enviaba mensajes de apoyo a sus seguidores. Tanto las piezas del exsenador morenista como de la antigua funcionaria del presidente Vicente Fox fueron realizadas por softwares de inteligencia artificial.

Confirmando la relevancia del tema, la polémica del uso de IA saltó en poco al tiempo al principal escenario político y mediático del país: las conferencias de prensa del presidente Andrés Manuel López Obrador. Consultado por el tema, el mandatario dijo que en este ciclo electoral se emplearía el uso de inteligencia artificial para llevar adelante una «guerra sucia», pero minimizó sus riesgos ya que, en su visión, «hoy en día la gente es muy precavida y no cae [en mentiras o información falsa] a la primera».

Pero pese a los dichos del mandatario mexicano asegurando que la ciudadanía era capaz de distinguir entre una noticia falsa y una verdadera, los especialistas consultados por Sputnik concuerdan en que son parte de una tendencia que llegó para quedarse en la política mexicana, y que provoca una vulneración del derecho de informarse de manera veraz de cara a emitir un voto.

Escorcia, quien ha debido exiliarse en Suecia tras recibir numerosas amenazas por denunciar el uso de bots y trolls en campañas mexicanas pasadas, le dijo a Sputnik que lo que se ha visto en las últimas semanas «nos indica que el uso de IA en el próximo ciclo electoral será el más extendido de la historia de México».

«En las elecciones presidenciales del 2018 vimos campañas de desinformación y granjas de bots, como también en las elecciones del año pasado del Estado de México, con ataques de un lado y del otro, pero está claro que los audios distorsionados son un fenómeno nuevo, distinto del uso electoral de la tecnología de campañas pasadas», explica.

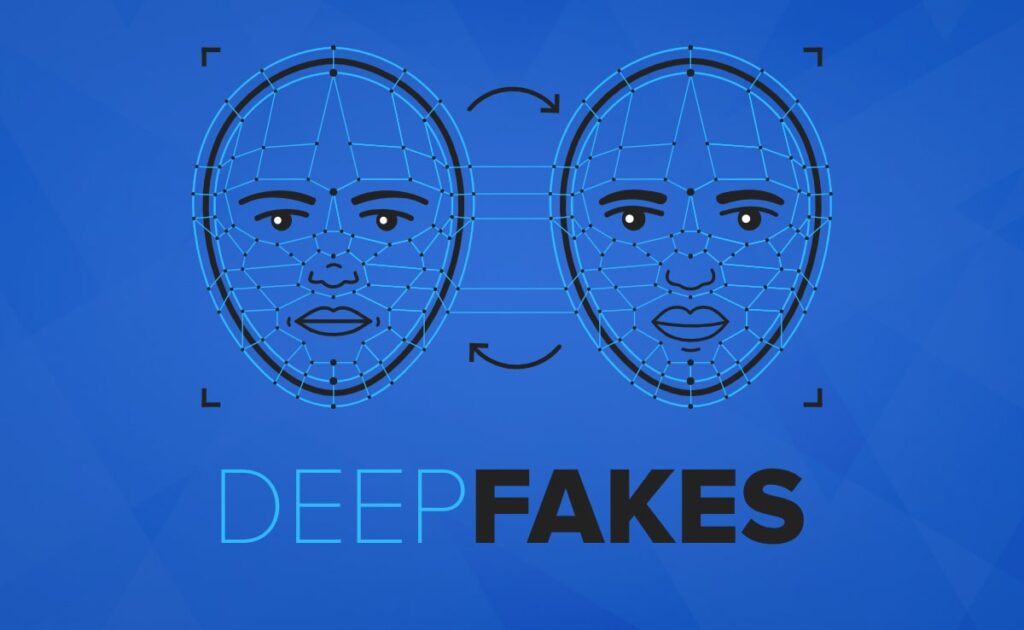

De la metadata a los ‘deepfakes’

El investigador Eloy Caloca Lafont, miembro del Tlatelolco LAB de la Universidad Nacional Autónoma de México (UNAM), explica a Sputnik que la manipulación informativa que se está viendo en la difusión de deepfakes o audios y videos distorsionados es un fenómeno nuevo, distinto del uso electoral de la tecnología de campañas pasadas.

Uno de los problemas que contribuyen a la proliferación de esta desinformación en la esfera pública es la falta de legislación con respecto a la inteligencia artificial. De hecho, la Ley General de Instituciones y Procedimientos Electorales (LEGIPE), que establece las normas de las campañas electorales en México, no hace mención siquiera al uso de plataformas, redes sociales o la Internet, limitándose a establecer los detalles de las campañas en medios tradicionales como la radio y la televisión.

on respecto a las restricciones que se podrían establecer para supervisar el uso de este software, el analista admite sentirse «pesimista» sobre la posibilidad de limitar su impacto nocivo. «Es algo que requeriría de muchísimo asesoramiento técnico, mucha voluntad política, realizar todo tipo de foros y debates, y no veo a tantos actores de distintos ámbitos, político, empresarial, tecnológico, poniéndose de acuerdo en este tema, al menos no por ahora», dice.

Según Escorcia, esta falta de regulación sobre la IA es un tema que no solo debería importar por sus repercusiones en el debate político, sino también por el impacto que tendrá en otros sectores productivos que podrían verse perjudicados por su uso indiscriminado.

«LA IA no es solo una cuestión de desinformación, sino también de automatización de muchas tareas. Hay muchos empleos que se están perdiendo, y muchos miles más que podrían perderse en un futuro si no se hace nada. Empleados de call centers remplazados por bots, por ejemplo, o artistas del sector audiovisual, siendo reemplazados por software para crear imágenes con IA», advierte, añadiendo que es del interés de toda la sociedad que los políticos aborden con seriedad esta nueva tecnología.

Sin embargo, se lamenta Escorcia, el interés político y monetario de las grandes empresas trasnacionales con respecto a que siga este negocio es demasiado grande para que algo suceda.

«Las plataformas por supuesto tienen mucho que ver en esto, pero ellos se excusan diciendo que no son responsables de lo que suben las personas, porque, claro, para ellos significa una gran entrada de dinero de las agencias que pagan por viralizar estos contenidos. Por eso, creo que la IA y la desinformación que produce es algo imparable y muy difícil de regular, porque se trata de un negocio millonario y opaco. Y por supuesto los que pierden son los ciudadanos, porque el debate público se empobrece y se radicalizan las posturas», concluye.

Fuente Spunik